安装收费 500,卸载收费 299——当一个开源软件需要"上门服务"才能用起来,说明从代码到产品之间,断了一整层。

一、一千人的队伍,和一个没人回答的问题

3 月 6 日,深圳腾讯大厦楼下,近千人排队等工程师帮他们把 OpenClaw 装进电脑。上午 10 点开始排队,11 点预约号全部发完。有人从香港来,有人从杭州来。小红书上,"上门安装 OpenClaw"报价 300 到 1000 元不等。闲鱼上,一键安装包卖 8 到 50 元。

与此同时,另一股潮流正在涌动:第一批"养虾人"开始卸载了。OpenClaw 默认获取设备高级系统权限,在系统目录留下深度文件,手动删除极易导致系统崩溃。购物平台上"龙虾卸载"服务报价几十元到 299 元不等。3 月 10 日,工信部发布安全风险提示,明确指出 OpenClaw 在默认或不当配置下"存在较高安全风险,极易引发网络攻击、信息泄露等安全问题"。各地政府补贴的热情拥抱,到监管部门的谨慎提醒,只用了不到一周。

安装潮和卸载潮几乎同时发生。这个矛盾本身就是最好的信号:用户想要一个能替自己干活的 AI 数字员工,这件事已经被充分验证了——但从"想要"到"安全、可靠、好用",中间的路比所有人想象的都长。

作为一个在芯片行业做了多年解决方案的从业者,我看到这个场景时想的不是"OpenClaw 火不火",而是一个至今没人回答的问题:

为什么一个拥有 30 万+ GitHub Star、周访问量 200 万的生态里,至今没有人能交付一个消费者或企业客户可以买回去、插上电、安全运行的硬件产品?

先看一组数据,感受一下这股需求的真实温度:

| 指标 | 数据 |

|---|---|

| GitHub Star | 300,000+(超越 React,GitHub 实用软件项目历史第一) |

| 周访问量 | 200 万+(单周峰值) |

| 月访问量 | 2,700 万+(2 月至 3 月增长 925%) |

| 社区技能包 | 超万个(其中 ClawHavoc 攻击活动已确认恶意技能 1,184 个) |

| 中国市场 | 使用量已超越美国(CNBC,2026.3,引用 SecurityScorecard 数据) |

| 地方政府补贴 | 深圳龙岗最高 200 万元/企业·年,无锡单项最高 500 万元,合肥最高 1000 万元 |

方向没有问题。但答案藏在下面这张表里。

二、所有人都在添砖,没有人在盖房子

| 当前生态角色 | 代表 | 在做什么 | 做不做硬件产品? |

|---|---|---|---|

| 大模型平台 | 扣子、百炼、文心、Kimi | 卖模型调用,按 Token 收费 | |

| 一键封装工具 | QClaw、ArkClaw、KimiClaw | 降低安装门槛,抢用户入口 | |

| 开源 Fork | CoPaw、NanoBot | 改运行时,适配自家生态 | |

| 地方政府 | 深圳、无锡、合肥 | 发补贴,释放产业信号 | |

| 硬件预装 | Beelink、QNAP、绿联、中科可控 | 在现有硬件上预装 OpenClaw | |

| 投机商家 | 华强北批发商、闲鱼卖家 | 旧盒子贴标、U 盘灌装 | |

| 安全、可靠、场景优化的 Agent 硬件产品 | ? | —— | 无人在做 |

逐层拆开看。

大模型平台在卖"大脑"。 字节的扣子、阿里的百炼、百度的文心、Moonshot 的 Kimi——它们给 OpenClaw 提供推理能力,按 Token 收费。对平台来说,每一个活跃的 OpenClaw 实例都是一台 24 小时不停消耗 Token 的印钞机。正如科技分析师 Poe Zhao 在 WIRED 的采访中指出的:“聊天机器人每次对话只用几百个 Token,一个活跃的 OpenClaw 实例每天可以消耗几十倍甚至上百倍。”——这就是腾讯工程师愿意在总部楼下免费帮人装软件的真正原因。

一键封装工具在抢入口。 腾讯的 QClaw、字节的 ArkClaw、Moonshot 的 KimiClaw——本质上是把 OpenClaw 包装进自家生态,争夺长期用户绑定。OpenClaw 创始人 Peter Steinberger 对此的评价直白而冷淡:“They copy yet they don’t support the project in any way.”

地方政府在发补贴。 深圳龙岗区"龙虾十条",企业采购 OpenClaw 解决方案按总投入 40% 补贴,年度最高 200 万元,购买"龙虾盒子"硬件按市场价 30% 补贴;无锡高新区"养龙虾十二条",对利用 OpenClaw 实现具身智能机器人、智能质检等关键技术的项目,最高支持 500 万元;合肥高新区推出 15 条举措,单个项目最高可获 1000 万元资金扶持。这些政策释放的信号很积极,但补贴能催化生态,解决不了产品定义的问题。

硬件厂商嗅到了机会,但停在了"预装"层面。 Beelink 发布了预装 OpenClaw 的"龙虾红"Mini PC,售价 889 美元起;QNAP 出了在 NAS 上部署 OpenClaw 的教程;绿联做了类似尝试;中科可控推出了 M50"龙虾盒子"端云协同工作站。这些动作说明硬件厂商看到了趋势。但"在现有硬件上预装一个开源软件"和"设计一个为 Agent 工作负载深度优化的硬件产品",是完全不同的两件事——就像在一台普通 PC 上装 Windows 不等于做出了 Surface。

然后是更野的一层:投机者已经入场了。 华强北的二手设备批发商把压库存的旧盒子加价 800 到 1000 元,贴上"龙虾盒子"的标签就开卖。央视财经 3 月 13 日的报道记录了这个场景:一家批发商三四天出了 150 台,卖到同行都断货;有消费者从贵州专程跑到深圳,跑了好几家店买不到。淘宝和闲鱼上出现了 U 盘版 OpenClaw,宣称"配置模型即插即用",售价从几十元到数百元不等——安全研究人员立即发出警告:OpenClaw 权限极高,U 盘版极易被植入恶意 Skill,普通用户根本无法识别。国家信息安全漏洞库(CNNVD)的数据更直接:今年 1 月到 3 月 9 日,已采集 OpenClaw 漏洞 82 个,其中超危 12 个、高危 21 个。

这就是"中间层断裂"最生动的写照。当一个品类有真实需求但没有真正的产品来承接时,市场不会空着——它会被投机填满。 加价卖旧盒子的华强北批发商不是坏人,他们只是在用自己擅长的方式响应需求。但一台预装了 OpenClaw 的旧库存盒子,没有针对 Agent 负载做过算力优化,没有硬件级安全隔离,没有模型适配和端侧推理调优,没有场景化的交互设计——它不是一个产品,它是一个用热度包装的硬件。用户买回去的体验,和在自己电脑上装 OpenClaw 没有本质区别,只是省了安装这一步。

整个生态的现状是:框架是别人搭的,模型是别人训的,平台是别人建的,安装是别人帮你做的,甚至连投机硬件都有人卖了——但一个安全、可靠、针对 Agent 负载深度优化、让用户买回去插上电就能用的硬件产品,依然不存在。

三、三道坎:为什么这一次"中间层"特别难填

有人会说,中间层的空白是早期阶段的正常现象,市场会自然填补。这个判断低估了 Agent 硬件的特殊性。

第一道坎:确定性消失了。

传统硬件产品的开发是确定性游戏。路由器、摄像头、NVR——选芯片、跑 SDK、调参、量产、出货。成本在 BOM 表上锁死,功能在说明书里穷举。

Agent 硬件在四个维度上打破了确定性:

| 维度 | 传统硬件 | Agent 硬件 |

|---|---|---|

| 行为 | 固定功能,可穷举测试 | 自然语言驱动,不可穷举——用户一句"清理过期文件"可能误删项目文档 |

| 安全 | 固件层面,出厂锁定 | 动态执行环境——微软安全团队 2 月 19 日明确警告 OpenClaw"不适合在标准个人或企业工作站运行",因为它可以自行修改工作状态,可能导致凭证暴露和数据泄漏 |

| 成本 | BOM 出厂确定 | BOM 之外多了一笔随云端 Token 消耗波动的持续支出。未优化月均 LLM 成本可达数百美元,经裁剪、缓存、模型路由等优化可降至 30-40 美元——但这笔钱是持续的、浮动的 |

| 体验 | 固化在说明书中 | 取决于接入的大模型——接 Claude 和接国产 7B 小模型,同一条指令的完成度天差地别 |

这不是"更难做的硬件",而是一个需要全新产品定义方法论的品类。用做路由器的方法做 Agent 盒子,方向本身就错了。

第二道坎:上游还在剧烈移动。

过去做硬件产品,芯片方案成熟、OS 稳定、云服务标准化。方案商拿到 SDK 和参考设计,做加减法就能出货。

Agent 硬件面对的上游是什么?OpenClaw 频繁迭代,月均多个版本;大模型半年一次能力跃迁;安全标准还在制定中——3 月的 OpenClaw 和 1 月的已经不是同一个东西。中间层要做的不是在稳定平台上盖房子,而是在还在移动的地基上施工。同时,Agent 硬件需要方案商同时具备五种能力:AI 系统集成(框架适配、模型调优、Prompt 工程)、软硬件协同设计、安全合规(权限管控、审计、国密)、应用场景开发、市场运营。这五种能力的交集,在今天的市场上几乎找不到。

深圳有大量方案商。但他们的核心能力是在成熟方案上做微调——换壳、改接口、跑公版 SDK。Agent 硬件需要的是全新的产品定义和全栈整合能力,这和过去的游戏规则完全不同。

第三道坎:大厂不会替你做这件事。

大厂在 OpenClaw 生态中非常活跃,但请看清楚他们的商业逻辑:

| 公司 | 做的事 | 商业逻辑 |

|---|---|---|

| 字节跳动 | 扣子 AI 平台 | 卖模型调用、拉 DAU |

| 腾讯 | Lighthouse 一键部署 | 卖云主机 |

| 阿里 | 百炼 Agent 平台 | 卖云服务、模型 API |

| 百度 | 文心智能体平台 | 卖模型调用 |

| 360 | 智能体工厂 | 卖安全+流量入口 |

它们的 KPI 是 DAU、Token 消耗量、云收入——不是帮你搞定端侧硬件适配、安全合规和场景交互。Agent 硬件产品化过程中最难的那些环节——端侧推理优化、硬件级安全隔离、多模态外设协同、功耗与成本平衡——对大厂来说是 ROI 不划算的"脏活"。他们不会做。

四、芯片层面的格局:没有完美答案,但有明确方向

既然 Agent 硬件需要有人来做,那我们看一个更底层的问题:它到底需要什么样的芯片?

Agent 端侧载体的核心需求画像可以概括为五点:

| 需求维度 | 具体要求 |

|---|---|

| AI 推理算力 | 几到几十 TOPS,支撑语音识别/TTS、视觉检测、7B 级小模型本地推理 |

| 通用算力 | 足够运行 Linux、Docker、Agent 运行时、多任务调度 |

| IO 接口 | 摄像头、麦克风、传感器、执行器、网络——多模态 Agent 需要丰富的感知与执行通道 |

| 功耗 | 7×24h 运行,适合边缘部署的功耗区间 |

| 安全隔离 | 硬件级虚拟化、可信执行环境——Agent 执行不可信代码,必须有硬件兜底 |

这套需求画像,既不是手机 SoC、也不是传统 MCU、服务器 GPU 或 IPC 芯片能完美匹配的。

ARM 异构方案是当下的现实主力。 瑞芯微 RK3588 生态最成熟、开发板和社区资源丰富——华强北那些被抢购一空的"龙虾盒子",底下跑的大多是这颗芯片。但 6 TOPS 的 NPU 算力在 Agent 场景捉襟见肘,实测跑 1B 级小模型约 10-15 tokens/s,对实时多模态交互明显不足。瑞芯微的 RK182X 系列引入 RISC-V AI 协处理器,配备 20 TOPS 专用 NPU,7B 模型推理可达 59-180 tokens/s,但需要搭配 RK3588 双芯片方案,系统复杂度和成本都上升。爱芯元智 AX650 系列在视觉 AI 领域有独到壁垒,最高可达 INT4 72 TOPS / INT8 18 TOPS,AI-ISP 在低照度场景表现业界领先,全系列截至 2025 年 9 月累计出货超 1.65 亿颗 SoC——但全线 A55 小核的通用算力偏弱,更适合做 Agent 系统的"眼睛"而非"大脑"。全志 A733/T527 定位中低端,3 TOPS 的 NPU 对 Agent 载体明显不够。

这些 ARM 方案的共同架构特征是异构:CPU 和 NPU 分离,AI 推理需要在两者之间频繁搬运数据。在多模态 Agent 的典型工作流——“听→理解→决策→看→执行”——中,每一步都可能触发跨边界切换,调度开销是隐性的体验税。

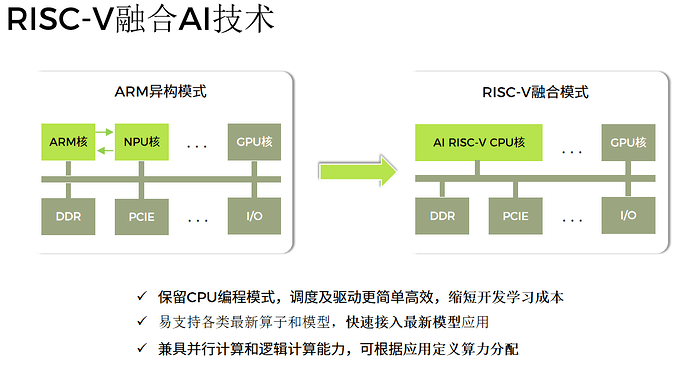

RISC-V 阵营出现了一条新思路。

今年 1 月发布的进迭时空 K3 提出了"同构融合"的架构方向——8 个高性能通用大核(X100)和 8 个 AI 核(A100)共享统一的 RISC-V 指令集,运行同一个 Linux 系统,试图从架构层面消除异构方案中的"双 OS/双栈"配置和跨边界数据搬运开销。30-60 TOPS 级 AI 算力(INT4 Dense 30 TOPS / Sparse 60 TOPS)、X100 核心支持 Hypervisor 硬件虚拟化、国密 SM3/SM4 加密支持、TDP 30W——从设计意图看,这套架构确实在"对着 Agent 负载画靶心"。Canonical 已宣布 Ubuntu 支持 K3 平台,Banana Pi 发布了基于 K3 的开发套件。RISC-V还有一个比ARM和X86架构更彻底的国产化优势,在国央企等行业有优势。

如果把几类主要方案放在一起看格局:

| 对比维度 | ARM 异构方案(RK3588 / 爱芯元智) | RISC-V 同构融合(K3) |

|---|---|---|

| 生态成熟度 | ★★★★★ 开发板、SDK、社区资源丰富 | ★★☆ Ubuntu/Docker 已支持,工具链仍在完善 |

| 通用算力 | A76 级大核(RK3588);仅 A55 小核(爱芯元智) | 130K DMIPS,接近 A76 水平 |

| 视觉 AI 能力 | 爱芯元智 AI-ISP;RK3588 | 需外挂或软件方案 |

| Agent 多模态负载适配 | 异构切换开销,多模态链路调度复杂 | 同构融合,单一 OS 调度,无跨边界损耗,通用算力,大模型快速部署 |

| 安全隔离 | 多数方案无硬件 Hypervisor | X100 核心支持 Hypervisor + 国密 SM3/SM4 |

| 授权与自主可控 | ARM 授权费 + 地缘风险 | RISC-V 零授权费,指令集开放 |

| 量产验证 | RK3588 出货量大;爱芯元智全系列 1.65 亿颗+ | 预计2026年4月份规模出货 |

真正值得关注的不是某颗芯片的参数高低,而是一个趋势:端侧 AI 芯片的设计靶心正在从"跑模型"转向"跑 Agent"。 这两个需求画像有本质区别——跑模型需要的是推理吞吐率,跑 Agent 需要的是通用算力、AI 算力、安全隔离、多模态 IO 的均衡组合。谁先按照 Agent 的需求画像重新定义芯片产品,谁就有机会在下一轮端侧硬件周期中卡位。但芯片层面的格局最终不取决于参数表,而取决于谁能围绕芯片最快构建出完整的 Agent 产品生态——这又回到了我们从头到尾在讨论的那个空白。

五、谁来修这条路

中间层空白既是最大的瓶颈,也是最大的机会。但"应该有人来做"不是答案。需要一条具体路径,需要想清楚三个问题:在哪里落第一脚、谁先动、动力机制是什么。

在哪里落第一脚:选场景比选技术更重要。

Agent 硬件不能一上来就做通用平台。第一步必须找到一个满足四个条件的场景:用户付费意愿明确、使用边界相对封闭(降低 Agent 不可控行为的风险)、对实时性要求适中(容忍端云协同的延迟)、已有成熟硬件形态可借力(降低用户认知门槛和渠道成本)。

用这个框架筛一遍,AI NAS 是最符合条件的第一落地场景。 NAS 天然 7×24h 在线、有存储、有网络、用户对数据隐私高度敏感(不愿上云),有明确的付费习惯。QNAP 已经发布了在 NAS 上部署 OpenClaw 的教程,绿联也做了类似尝试,论坛上用户在 Synology NAS 上自建 Agent 的讨论也在增多——这说明需求端的信号已经出现。但目前的方案只是"在 NAS 上跑一个通用 Agent 框架",远未达到"针对 NAS 场景优化的 Agent 产品"的水平。想象一下:一台 NAS 内置 Agent,能自动整理照片并生成摘要、监控家庭安防并用自然语言查询回放、管理智能家居设备、摘要和检索存储的文档——这不是科幻,而是把已有能力整合进一个已有硬件形态。在群晖和威联通之外,国产 NAS 品牌有大量竞品空间。

B 端的 AI 智能安防终端是第二个值得看的场景。 视觉+语音+Agent 联动(异常行为分析→自动报警→自然语言查询回放),买单逻辑清晰,项目制交付利于快速验证商业闭环。

谁先动:上游。

单靠下游方案商跑不通这条路。他们的能力结构不匹配——华强北的现状已经证明了这一点:当上游没有给出一个可用的起点时,下游能做的只有预装和贴标。传统硬件时代,芯片公司出 SDK + 参考设计,方案商拿到就能改板子出货。Agent 硬件也需要这样一个起点——只不过这次的参考设计不只是硬件,还包括 Agent 运行时适配、模型配置、安全策略和场景定义。

这意味着破局的第一步必须由芯片公司和模型/云厂商联合完成。芯片公司出硬件参考设计、端侧推理优化和安全方案;模型/云厂商出模型适配、云端协同和开发者工具。双方不是在发布会上签合作协议,而是坐在一起定义——这个 Agent 盒子长什么样、跑什么模型、安全边界在哪、成本怎么算——然后联合输出一个可以开机即用的全栈 Turnkey 方案。这个方案不是给展会演示的,是要能直接进入产品验证的。

动力机制是什么:给大厂算一笔账。

大厂为什么要参与这种"脏活"?因为每一台 Agent 端侧设备,都是云端模型调用的长期入口。

粗略算一笔账。一个中度活跃的 OpenClaw 实例,优化后月均 Token 成本约 30-40 美元。如果有 10 万台 Agent 终端设备进入市场,按 50% 月活率计算,仅 Token 消耗就意味着每年 1800-2400 万美元的 API 收入——而且是持续性收入,不是一次性硬件销售。这还不包括云存储、模型升级订阅等附加收入。对于今天已经在为 OpenClaw 提供一键部署服务的云厂商来说,与芯片公司联合打磨一个标杆硬件方案,本质上是在为自己的 Token 消耗池修建长期入水口。这不是慈善,是生意。

标杆立住之后,方案商才有东西可以复制。就像 RK3588 的参考设计催生了成百上千个边缘 AI 盒子一样,一个经过验证的 Agent 硬件全栈方案会成为方案商的"可复制起点"——在此基础上做场景适配、外观定制、渠道铺货。华强北的能力不是不强,而是缺一个对的起点。

六、不是结论,是一个判断

深圳腾讯大厦前的长队、购物平台上 299 元的卸载服务、华强北加价 1000 元仍然抢不到的旧库存盒子——表面上是一个开源软件的安装闹剧,本质上是一个被充分验证的需求和一个完全缺失的产品化能力之间的巨大落差。

OpenClaw 们证明了用户想要什么。现在,轮到有人证明自己能把它做出来。

芯片层面,设计靶心正在从"跑模型"转向"跑 Agent";场景层面,AI NAS 和智能安防终端已经出现了可验证的需求信号;生态层面,上游芯片公司和云厂商的联合标杆是撬动整条链路的第一根杠杆。

这条路最终会不会跑通,取决于一件事:有没有人愿意在这个所有人都在追热度的窗口期,停下来认真定义一个产品。